Tecnologia é usada por órgãos públicos e já vigia cerca de 40% da população sem regulamentação específica

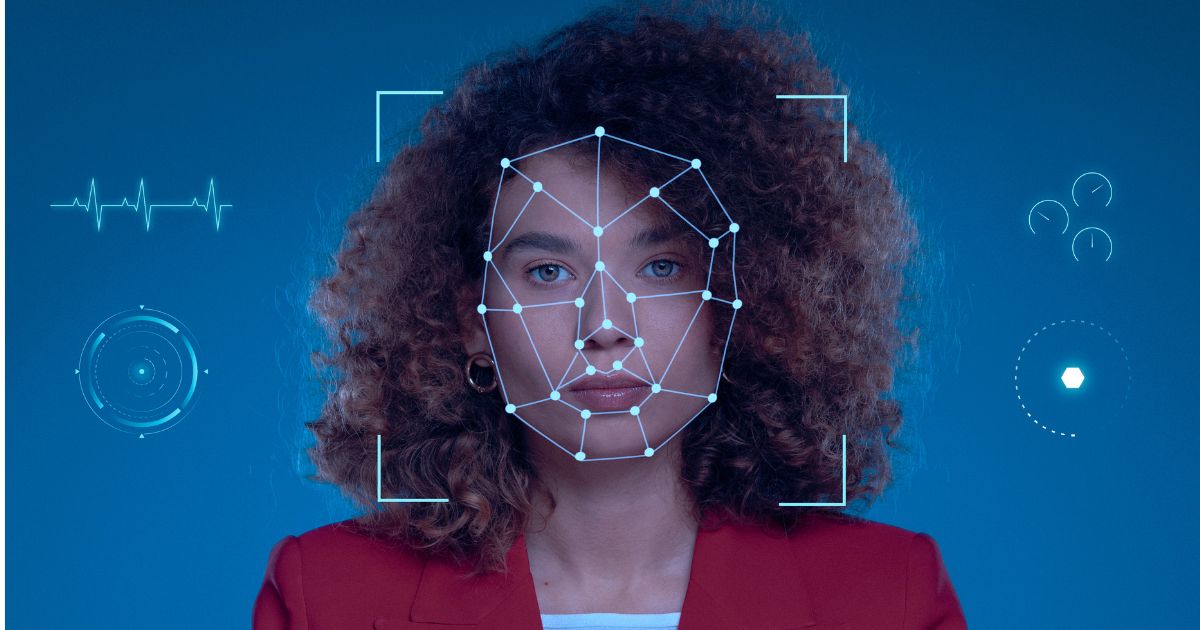

Reconhecimento facial – Um relatório divulgado nesta quarta-feira (7) pela Defensoria Pública da União (DPU), em parceria com o Centro de Estudos de Segurança e Cidadania (CESeC), vinculado à Universidade Candido Mendes (RJ), acende um alerta sobre o uso de tecnologias de reconhecimento facial por órgãos públicos no Brasil. Segundo a pesquisa, o país conta atualmente com pelo menos 376 projetos ativos capazes de monitorar cerca de 40% da população brasileira, o equivalente a 83 milhões de pessoas.

O estudo, intitulado Mapeando a Vigilância Biométrica, aponta que a disseminação desses sistemas teve início com os megaeventos esportivos realizados no Brasil, como a Copa do Mundo de 2014 e os Jogos Olímpicos de 2016.

LEIA: Brasil é um dos países com maior uso de internet por crianças, com quase 100% conectadas

De acordo com os dados coletados entre julho e dezembro de 2024, ao menos R$ 160 milhões em recursos públicos já foram investidos nos projetos identificados — número que não considera os estados de Amazonas, Maranhão, Paraíba e Sergipe, que não responderam à pesquisa.

Apesar do avanço da tecnologia, os pesquisadores alertam que as soluções regulatórias estão atrasadas, e que o país ainda não possui uma legislação específica para o uso dessas ferramentas.

O relatório critica a ausência de mecanismos de controle externo, a falta de padronização técnico-operacional e a escassez de transparência na implementação dos sistemas. Para os autores, essas lacunas ampliam os riscos de erros graves, violações de privacidade, discriminação e uso indevido de recursos públicos.

Em outro levantamento, o CESeC identificou 24 casos de falhas em sistemas de reconhecimento facial entre 2019 e abril de 2025. Um dos mais emblemáticos foi o do personal trainer João Antônio Trindade Bastos, de 23 anos, confundido com um foragido durante uma partida de futebol em Aracaju (SE), em abril de 2024. Após ser retirado da arquibancada, revistado e interrogado, Bastos teve sua identidade confirmada e foi liberado. O caso gerou repercussão nas redes sociais e levou à suspensão do uso da tecnologia pela Polícia Militar de Sergipe.

O relatório destaca que Bastos é negro, característica comum entre as vítimas de erros dos sistemas de reconhecimento facial, tanto no Brasil quanto em outros países. “Mais da metade das abordagens policiais motivadas por reconhecimento facial resultaram em identificações equivocadas, evidenciando o risco de prisões indevidas”, apontam os pesquisadores.

Estudos internacionais citados no documento indicam que as taxas de erro são “desproporcionalmente elevadas para determinados grupos populacionais, sendo de dez a 100 vezes maiores para pessoas negras, indígenas e asiáticas em comparação com indivíduos brancos”.

O Parlamento Europeu, em 2021, já havia alertado que “, concebidos para a identificação biométrica a distância de pessoas singulares, podem conduzir a resultados enviesados e ter efeitos discriminatórios.”

No campo legislativo, os autores destacam a aprovação, pelo Senado, do Projeto de Lei n.º 2338/2023, que propõe regulamentar o uso de inteligência artificial, incluindo sistemas biométricos na segurança pública. No entanto, observam que o texto aprovado inclui tantas exceções que, na prática, pode acabar funcionando “como uma autorização ampla para a implementação” desses sistemas.

“Considerando o histórico de abusos e a falta de mecanismos eficazes de controle, essa abertura para uso acaba mantendo a possibilidade de um estado de vigilância e de violação de direitos.”

Como resposta aos riscos apontados, o relatório recomenda medidas urgentes como a criação de uma lei nacional específica, a padronização de protocolos que respeitem o devido processo legal e a realização de auditorias independentes. Os especialistas também defendem maior transparência nos contratos públicos, capacitação de agentes, exigência de autorização judicial para o uso de dados de reconhecimento facial e limitação no armazenamento de dados biométricos.

“Esperamos que esses achados possam não só orientar e subsidiar a tramitação do PL 2338 na Câmara dos Deputados, mas também servir de alerta para que órgãos reguladores e de controle estejam atentos ao que ocorre no Brasil. O relatório evidencia tanto os vieses raciais no uso da tecnologia quanto problemas de mau uso de recursos públicos e falta de transparência na sua implementação”, afirma, em nota, o coordenador-geral do CESeC, Pablo Nunes.

(Com informações de Agência Brasil)

(Foto: Reprodução/Freepik)